ChatGPT类应用服务的数据合规挑战 个人互联网服务的特殊性探讨

随着人工智能技术的快速发展,以ChatGPT为代表的生成式人工智能应用已成为个人互联网服务中的重要组成部分。这类服务不仅在技术架构上与传统互联网服务存在差异,其在数据合规方面也呈现出独特的复杂性和挑战性。本文将探讨ChatGPT类应用在个人互联网服务领域数据合规的特殊性。

一、数据处理的多样性与复杂性

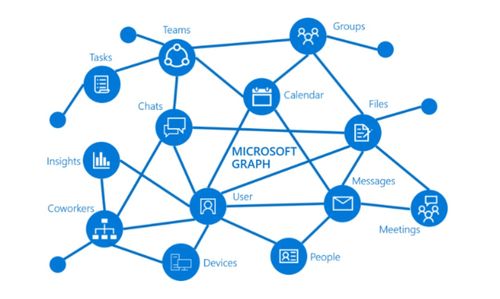

ChatGPT类应用通常涉及多类型、大规模的数据处理,包括用户输入的个人数据、交互行为数据、模型生成的内容等。与传统的搜索引擎或社交平台不同,生成式AI模型在训练阶段可能使用海量公开数据,这些数据中可能包含个人信息或版权内容,如何确保数据来源的合法合规成为关键问题。用户与模型的实时交互过程中产生的新数据,既可能包含敏感个人信息,也可能涉及知识产权的生成,这增加了数据分类和合规管理的难度。

二、用户数据的动态生成与模糊边界

传统互联网服务中,用户数据通常较为明确,如注册信息、浏览记录等。而在ChatGPT类应用中,用户输入的提示词本身可能包含敏感信息,模型生成的回复也可能基于用户输入衍生出新的个人信息。这种动态生成的数据流使得数据主体、控制者与处理者之间的界限变得模糊,给用户同意机制、数据删除权(被遗忘权)等合规要求的落实带来挑战。例如,当用户要求删除某次对话记录时,如何确保模型中已学习的相关模式或信息被彻底移除,在技术上存在难度。

三、跨国数据流动的合规挑战

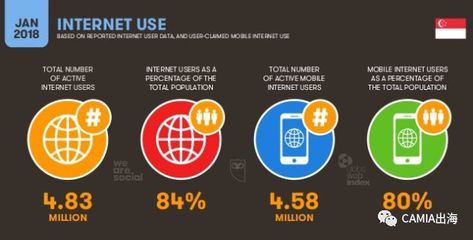

ChatGPT类服务通常依赖全球化的技术架构和训练数据,这导致数据跨境流动成为常态。不同国家和地区对数据出境有着不同的法律规定,如欧盟的GDPR、中国的《个人信息保护法》等都对数据跨境传输设置了严格条件。生成式AI模型的训练可能涉及来自多个司法管辖区的数据,而其服务又面向全球用户,如何设计符合各地法规的数据治理体系,成为企业必须面对的复杂课题。

四、内容生成与责任归属的特殊性

当ChatGPT类应用生成的内容涉及侵权、虚假信息或非法内容时,责任归属问题变得复杂。传统互联网平台通常作为信息存储或传输的中间方,而生成式AI直接参与内容的创造过程。这引发了关于服务提供者是否应对生成内容承担责任、在何种程度上承担责任的法律讨论。从数据合规角度看,如何建立内容审核机制、实现生成内容的可追溯性,同时平衡技术创新与风险防控,是此类服务特有的合规难点。

五、透明性与解释权的实现难题

数据保护法规通常要求数据处理活动透明,并赋予数据主体一定的解释权。但对于基于复杂神经网络的人工智能模型,其决策过程往往具有“黑箱”特性。当用户询问“为什么生成这样的回答”或“我的数据如何被使用”时,提供清晰、易懂的解释在技术上存在挑战。这要求服务提供者不仅要优化模型的可解释性,还需在隐私政策和使用条款中,用通俗语言向用户说明数据处理的逻辑与边界。

六、针对个人互联网服务的合规建议

面对上述特殊性,ChatGPT类应用在个人互联网服务领域可考虑以下合规路径:实施“隐私设计”和“默认隐私”原则,将数据保护要求嵌入产品开发全流程。建立分级分类的数据管理策略,对不同敏感度的数据采取差异化的保护措施。再次,加强用户告知与同意管理,特别是针对数据用于模型训练的情形,应提供清晰的选择机制。投资于可解释AI技术和审核工具的开发,以提升透明度和内容安全性。积极参与行业标准与最佳实践的制定,推动适应新技术特点的合规框架形成。

ChatGPT类应用在个人互联网服务领域的数据合规,既继承了传统数据保护的基本要求,又因技术特性而衍生出新的挑战。这些特殊性要求企业、监管机构和学术界共同探索与时俱进的治理模式,在促进人工智能创新发展的切实保护用户的数据权益与隐私安全。随着技术的演进和法规的完善,构建负责任、可信赖的生成式AI服务生态,将成为个人互联网服务可持续发展的重要基石。

如若转载,请注明出处:http://www.yq2330.com/product/77.html

更新时间:2026-04-18 02:52:24